2025年GPT-4O最值得关注的几个版本更新

2025年的到来,GPT-4O经历了几次关键的更新,这些更新不仅提升了其处理能力,还增强了其多模态功能、响应速度以及用户交互体验。本文将介绍2025年GPT-4O最值得关注的几个版本更新,帮助你了解其背后的技术演进。

1. 多模态能力的进一步增强(2025年4月)

在2025年4月,GPT-4O的多模态能力得到了一次重大提升,尤其是在图像和语音处理方面。GPT-4O不再局限于文本输入输出,而是能够处理更多类型的数据,支持图像生成、语音识别以及语音合成,极大地扩展了其应用场景。

更新亮点:

-

图像生成和识别:通过GPT-4O Image 1,用户可以在对话中直接生成图像,提供更高质量和更丰富的视觉输出。例如,用户可以要求GPT-4O生成某个特定场景的插画或设计草图。

-

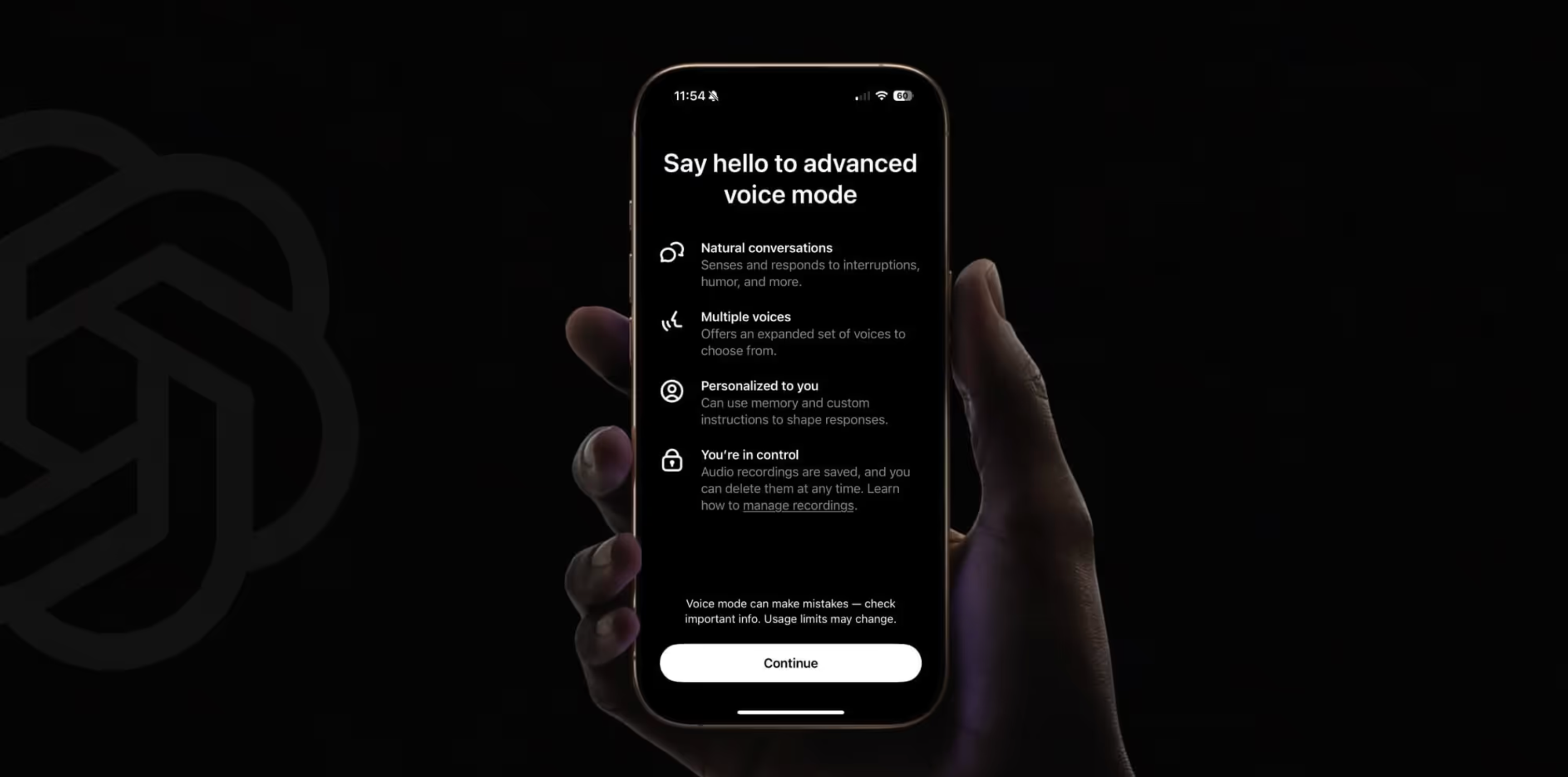

语音输入输出:增强了语音识别和语音合成功能,支持更加自然的语音交互,适用于虚拟助手、客户服务等场景。

应用场景:这项更新对于创意产业、教育、客户服务等行业尤为重要,它不仅为用户提供了更高质量的内容生成,还增强了与AI的互动性。

2. 上下文理解能力提升(2025年5月)

2025年5月的更新专注于提升GPT-4O的上下文理解能力,尤其在长时间对话和复杂问题处理中,表现得更加稳定和连贯。

更新亮点:

-

长对话一致性:GPT-4O现在能够更好地维持长对话中的一致性,理解并记住之前的对话内容,从而为用户提供更加流畅的多轮对话体验。

-

语境适应能力:模型对各种语境的适应能力大幅提升,能够处理复杂的语境变化并给出符合上下文的回答。

应用场景:这一更新特别适合用于客服系统、虚拟助手等需要长时间对话的场景,能够显著提升用户体验和服务质量。

3. 推理能力与精准度提升(2025年6月)

GPT-4O的推理能力在2025年6月的更新中得到了极大提升,模型在处理复杂任务和数据分析时的精准度更高,尤其在科学、技术、数学等领域的应用中表现突出。

更新亮点:

-

科学与技术领域的推理提升:GPT-4O能够更准确地分析和推理复杂的科学数据,给出清晰、可操作的解决方案。

-

数学推理能力:在数学问题解决方面,GPT-4O提供了更强的推理能力,能够解决更复杂的数学问题和方程式。

应用场景:这一更新对于科研人员、工程师以及需要进行深度数据分析的行业尤为重要,可以帮助他们提高工作效率,减少人工计算和分析的时间。

4. 用户控制与定制化能力增强(2025年3月)

2025年3月,GPT-4O的更新增加了更多用户控制和定制化功能,使得用户可以更灵活地调整AI的行为和输出,确保模型生成的内容符合个人或企业的需求。

更新亮点:

-

自定义指令:用户可以通过输入指令,定制GPT-4O的响应方式,包括调整语气、风格、输出格式等。

-

行为控制:用户可以控制模型的回答风格,选择更正式、幽默、简洁等不同风格。

应用场景:这一功能非常适用于企业用户,尤其是在需要生成大量内容(如广告文案、报告、邮件等)的场景。通过定制化指令,GPT-4O能够更好地符合品牌要求和用户需求。

5. API与集成能力扩展(2025年2月)

2025年2月的更新进一步扩展了GPT-4O的API功能,使其在跨平台应用中的集成能力更强,支持更多的外部工具和系统集成。

更新亮点:

-

增强API调用能力:用户可以通过API更方便地将GPT-4O集成到现有的应用程序中,包括企业级应用、网站、移动应用等。

-

实时交互支持:新增的WebSocket和WebRTC支持,使得GPT-4O可以实时处理大量数据并进行快速响应,适用于需要实时交互的场景,如实时客服、在线教育等。

应用场景:这一更新使得GPT-4O能够更加灵活地服务于企业级应用和开发者,帮助他们实现更高效的自动化和数据处理。